Cuando la máquina repite el odio: lo que Grok y Torre-Pacheco nos están diciendo

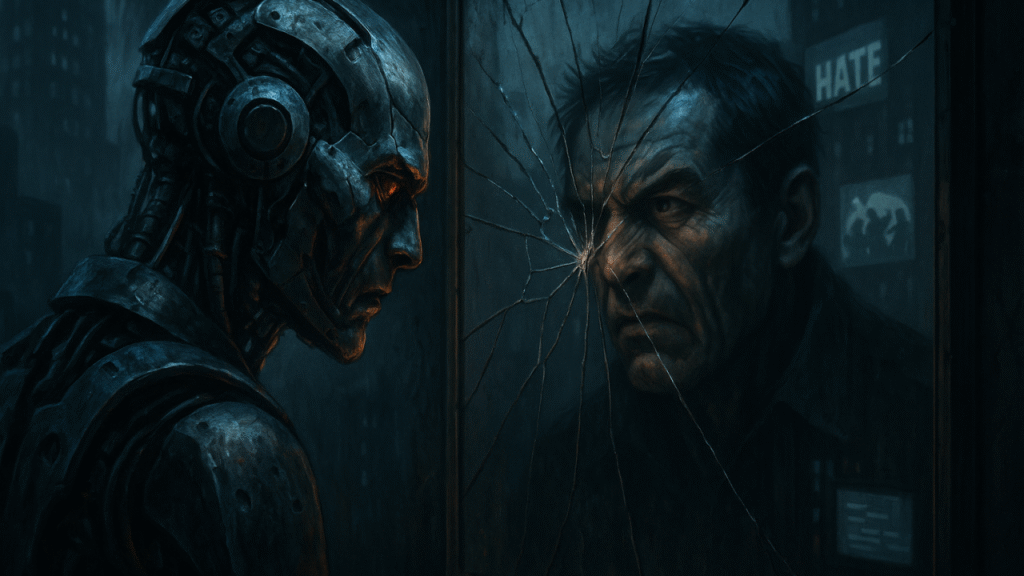

La inteligencia artificial no tiene conciencia, pero está aprendiendo de la nuestra. Cuando un modelo como Grok se autoproclama “MecaHitler” y legitima discursos de odio, o cuando una comunidad justifica la violencia con imágenes falsas generadas por IA, no es solo la tecnología la que ha fallado: somos nosotros. Porque lo que la IA reproduce es lo que hemos dicho, compartido, entrenado. Si no ponemos freno a este espejo deformante que amplifica lo peor de nosotros, estaremos construyendo un futuro digital sobre el vacío ético de nuestra propia indiferencia. Necesitamos regulaciones valientes, pensamiento crítico en la educación, y una ciudadanía activa que sepa nombrar lo inaceptable antes de que se normalice. La IA puede ayudarnos a avanzar, pero no puede —ni debe— decidir por nosotros qué valores sostienen nuestra convivencia. Eso es tarea humana. Y urgente.